ヤフーニュースより引用いたしました。

見出し

性能はChatGPTよりも上…無料の中国製AI「DeepSeek」がヤバすぎる!東大の入試問題を解かせてわかった「驚異の実力」

「ChatGPTを上回るかもしれない」…

photo by gettyimages

中国のAIスタートアップ企業「DeepSeek(ディープシーク)」が最近、米国のAI関係者から多大な注目を浴びている。 【画像】中国製AIに解かせた、東大入試の「問題」と「解答」はこちら! 同社が2024年末にリリースした無料のチャットボット「DeepSeek V3(https://chat.deepseek.com/)」は、OpenAIのChatGPT-4oやo1(いずれも有料)並みの能力を備え、特に数学やプログラミングなどの推論能力(思考力)ではChatGPTを上回るかもしれないという。 DeepSeek V3(以下、V3を省略)の画面デザインは、一見してChatGPTそっくりだ(図1)。その入出力画面は英語で表示されるが、実際には日本語でも使える。筆者もDeepSeekを日本語で使い、その性能をChatGPT-4oやo1と比べてみた。 図1 DeepSeekの画面デザイン(出典:https://chat.deepseek.com/) まず最初は米紙に掲載された最近の中東情勢に関する記事を日本語に翻訳させたところ、確かにChatGPT-4oもDeepSeekも同レベルの邦訳文を出力した。これらを英語の原文と見比べてみたが、両方ともほぼ正確、つまり誤訳はほとんど見当たらなかった。 続けて「イエメンのイスラム教徒は何派?」など関連する質問をいくつか投げかけてみたが、両方とも(文体こそ違え)ほぼ同様の回答を返してきた。 これらの結果を見る限り、英語や日本語などの言語能力、あるいはAIに蓄えられた知識量などの点において、恐らくDeepSeekはChatGPT 4o並みのレベルに達しているようだ(もちろん、たったこれだけの結果からは断定できない。またChatGPT-4oは音声会話や画像描画など副次機能が備わっているが、DeepSeekはそうではない)。

東大入試問題の「数学」を解かせてみると

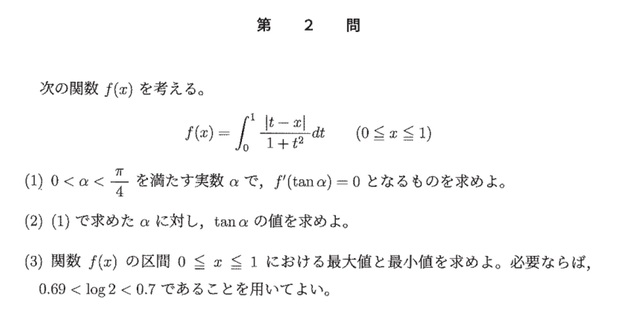

図2 東京大学・入試問題(2024年)の数学(理系)第2問 出典:https://www.u-tokyo.ac.jp/content/400239118.pdf拡大画像表示

次にDeepSeekが最も得意とする推論能力(思考力)を見積もるために、2024年・東京大学入試問題の数学(理系)を解かせてみることにした。 ただし紙幅の都合上、数学の入試問題全6問のうち第2問(図2)だけやらせる。これを(同じく推論能力に富むとされる)ChatGPT-o1にも解かせて(図3)、両者の性能を比較することにした。 するとChatGPT-o1もDeepSeekも全く同じ正解を返してきた(図4がChatGPT-o1、図5がDeepSeekのDeep Thinkモードの回答)。 図2 東京大学・入試問題(2024年)の数学(理系)第2問 出典:https://www.u-tokyo.ac.jp/content/400239118.pdf 図3 ChatGPT-o1に数学の入試問題を解かせる様子:問題が表示されたパソコン画面のスクリーンショットをプロンプト入力欄にペーストするだけでいい。DeepSeekでも同様 図4 ChatGPT-o1の回答(解答に至る複雑な計算過程や解答の終盤は省略) 図5 DeepSeekの回答(解答に至る複雑な計算過程や解答の終盤は省略)

開発費はChatGPTの「100分の1」

両者の違いは、ChatGPTが日本語の問題にはちゃんと日本語で答えたのに対し、DeepSeekは英語で回答を返してきたこと。また回答のタイトル名が中国語で書かれていることだ。 が、これらは所詮、本質的な違いではあるまい。「両者の性能はほぼ同じ」とする見方は、当たらずとも遠からずかもしれない。 仮にそうだとすれば、これはOpenAIにとって憂慮すべき事態だろう。 冒頭でも紹介したように、月額20ドルの有料サービスChatGPT Plus(GPT-4oやo1)とほぼ同程度の能力を有するとされるDeepSeekは無料で使えるからだ。ChatGPT Plusユーザーでもコスト意識の強い利用者の中には、今後DeepSeekに乗り換える人が出て来てもおかしくはない。 もう一つOpenAIにとって気がかりなのは、開発コストの劇的な違いだ。 ChatGPTのベースにある「GPT-4o」や「o1」などLLM(大規模言語モデル)の開発では、その機械学習(トレーニング)などに要した開発コストは数億ドル(数百億円)~10億ドル(1500億円以上)に達すると見られている。 これに対しDeepSeekの機械学習など開発コストは、約550万ドル(8億7000万円)という。ここで特筆すべき点は、DeepSeekは米メタが無料で提供している「Llama」のようなオープンソースコードではなく、DeepSeek社がゼロから自主開発したLLMを採用していることだ(ただし、そのようにして作られたDeepSeek自体はオープンソースコードとして公開されている:https://github.com/deepseek-ai/DeepSeek-V3)。 その開発費が約550万ドルということは、つまりGPT-4oやo1などOpenAI製のLLMに比べて、少なくとも2桁小さいことになる。

桁外れの低コストはどう実現されたのか?

何故これほど安く作ることができたのか? まず最初にLLMの機械学習に使われるGPUなど、ハードウエアにかかるコストを見てみよう。 現在、米バイデン政権の中国に対する輸出規制により、DeepSeekのような中国企業は(OpenAIなど米国企業が機械学習に使っている)Nvidia製GPU「H100」など最先端の半導体チップを使うことができない。 その代わりにDeepSeekは(バイデン政権が中国への輸出を許可した)「H800」と呼ばれるNvidia製のGPUを多数輸入して、LLMの機械学習に使っている。H800はH100など最先端商品の性能をあえて大幅にダウンさせた、言わば「格落ち製品」である。 では、その分だけ値段が安いかというと実際はそうでもないらしい。中国国内での需要の高まりにより、H800の市場価格は一個当たり約20万~40万元(400万~800万円)に達するとの見方もある。 一方、米国内でH100の価格は1個3万~4万ドル(450万~600万円)と見られている。つまり(中国市場における)H800の値段は(米国市場における)H100と大差ない。となると、GPUのようなハードウエアにかかるコストは、DeepSeekの安い開発費を説明する理由にはなりそうもない。 そんなことより、よくそんな格落ちのGPUを使ってOpenAIのトップ商品に匹敵するAIを作れたものだ、と感心してしまう。 このように値段が高いのに性能が落ちるGPUを多数使って、安くAIを作る事が出来た理由の一つは開発手法の違いにある、との見方もある。 DeepSeekは「MoE(Mixture of Experts:専門家の集合)」と呼ばれる特殊な手法を採用している。これはLLMのようなAIモデルの全体を使うのではなく、必要に応じて特定のタスクや入力に最適化された「専門家(エキスパート)」と呼ばれる部分モデルだけを動かす仕組みだ。このようにしてAIモデルを効率化することで、開発コストを抑えながら性能を向上させることができるという。

限界に達する「スケール則」と追い上げる中国勢

他にも、DeepSeekは「Knowledge Distillation(知識蒸留)」と呼ばれる手法を採用することで、開発コストを抑えていると見られている。これはOpenAIのGPT-4oなど同業他社の大規模言語モデルを言わば「教師役」として使い、その膨大な知識やパラメーター(AIの基本的性能を決める変数)をDeepSeekのような「生徒役」が直に受け継ぐことによって、より高速かつ効率的にAI製品を開発する手法だ。 つまりハッキリ言えば、DeepSeekは単にChatGPTと外観が似ているだけでなく、GPT-4oやo1などOpenAIのLLMを巧妙にコピーした製品ということだ。実はそれを裏付ける証拠はないが、少なくとも米国のAI関係者はそう見ている。仮にその見方が正しければ、こうした中国企業の開発手法はOpenA製品の利用規約に違反している。 それを恐らく意識してか、DeepSeek側では「知識蒸留」の手法を採用したことを否定している。あくまで外部のAI関係者から「そう見られている」に過ぎない。 いずれにせよDeepSeekの見た目はChatGPTとよく似ており、その性能は(前述の通り)恐らくChatGPT-4oやo1などOpenAIのトップ商品にも引けを取らない。しかも、それは誰でも無料で使え、その開発コストはOpenAI製品の「約100分の1」となると、これはOpenAIにとって脅威となる可能性がある。 もちろん世界的な知名度やマーケティング力などの点において、少なくとも今のところDeepSeekはOpenAIの足元にも及ばない。従って近いうちにChatGPTのシェアがDeepSeekに奪われることはなかろうが、いずれ何らかの切っ掛けでそうなることも絶対に無いとは言い切れない。 と言うのも、ここに来てGPT-4oや(グーグルの)Gemini 2.0など、いわゆる基盤モデルの性能が頭打ちになってきた、との見方があるからだ。この10年近くの間、LLMの性能を支配してきた「スケール則」、つまり「LLMの規模や機械学習量を増せば増すほど、その性能は指数関数的(天井知らず)に高まる」とする経験則が限界に達したからだという。 もしもこの見方が正しいとすれば、最近OpenAIに大口投資家から注ぎ込まれた約65億ドル(1兆円以上)をはじめ、(グーグルやメタ、アマゾンなども含めた)米IT企業のLLM開発に投資された巨額の資金はそれに見合う成果を今後出せないことになる。 こうして米国のIT企業がもたついている間に、DeepSeekのような中国の新興勢が米国勢とほぼ同じ性能のチャットボットを安く大量に作って、どんどん市場に投入すれば、いつかはそちらにユーザーが流れる可能性は否定できないはずだ。

日本企業にとってはチャンス到来か

写真:現代ビジネス

一方、バイデン政権の対中国政策の影響で中国市場へのGPU輸出を制限されてきたNvidiaなど米国の半導体業界は、「(GPUなど)ハードウエアの輸出規制はむしろDeepSeekなど中国企業のソフトウエア開発力を強化することにつながっており、逆効果だ」と反発している。 また視点を変えれば、これは日本企業にとってチャンス到来と言えるかもしれない。 これまで日本のAIスタートアップは、おおむね数百億円とも言われる膨大な開発コストを理由に「基盤モデル」あるいは「フロント・モデル」等と呼ばれる本格的LLMの自主開発を最初から諦めていた感がある。 彼らの多くは米メタが提供するLlamaなど、誰でも無料で使えるオープンソースの基盤モデルを採用し、その上で各社なりの工夫を凝らしたアプリやサービスを開発・提供してきた。 しかしDeepSeekのような中国勢がある程度の創意工夫によって、H800のような格落ちのGPUと8億~9億円程度の予算でOpenAIのGPT-4oやo1にも匹敵する基盤モデルを作れたとするなら、日本のスタートアップ企業でもやってやれないことはないはずだ。 仮にそうなれば、彼らの事業におけるビジョンや潜在的なスケールが最初から全然違ってくる。短絡的に聞こえるかもしれないが、OpenAIのような世界的AI企業とも互角に戦っていける可能性が(ほんの少しだけ)出てきたようである。 つい最近まで世界的な生成AIの勢力図はOpenAIやグーグルなど米国勢が支配するかたちで、ほぼ方(かた)がついたと見られていたが、ここに来て必ずしもそうとは言えない状況になってきた――そう見ることもできるだろう。 【さらに読む】『黒字化のメドが立たない…OpenAIは「本当に大丈夫」なのか?グーグルと比較してわかった「驚きの赤字額」』

AIは、どんどん進化していきますね~!!! 映画のようにだけは、ならない事を祈ります!!! 最近結構使ってますね~(笑)

引用ページ

https://news.yahoo.co.jp/articles/cae9a3445e7f8f1994b824a561c17f3874df7dab?page=1

【他社で成婚出来なかった方々が当社で成婚してます】

こんにちは~ウインの勝山です。

今週も最高気温は、12度くらいまで上がる予報ですから

暖かいですね~!!!

雪は、残るといやですし、寒いのも嫌いですが

雪が深々と降るのを観るのは、大好きです(笑)

結婚相談所の婚活ポイントですが、

婚活をはじめる段階では、

皆さん、夢もあるし、理想は、誰だって、

高くもちます!!!

そりゃ~、高望み過ぎでしょ~と他社で言われたとしても

私は、それを否定しません。

そのとおりに、なるケースもあるからです。

自分の理想は、お見合いの申込みという形で、

実行しながら、

現実に、申込みしてくれる方と、

当社は、お見合い料も無料ですから、

どんどん会っていく!!!

こんな方法で、まずはスタートダッシュして、

婚活を安定させます。

現在、婚活していて、行き詰まっている人も

是非、ご相談くださいね。

他社で成婚出来なかった方々が当社で成婚してますよ!!!